CORAMO

Robot humanoide de doble brazo controlado por voz con IA completamente local. Sin internet. Sin nube. Sin terceros.

Robot humanoide de doble brazo controlado por voz con IA completamente local. Sin internet. Sin nube. Sin terceros.

Cada letra del nombre define un pilar de diseño irrenunciable.

Trabaja junto a personas, no las reemplaza. Diseñado para compartir espacio físico con humanos de forma segura.

Aprende nuevas tareas cambiando software. Sin rediseño mecánico para agregar nuevas funciones.

Toma decisiones por sí mismo basado en lo que escucha y ve. Sin operador humano en tiempo real.

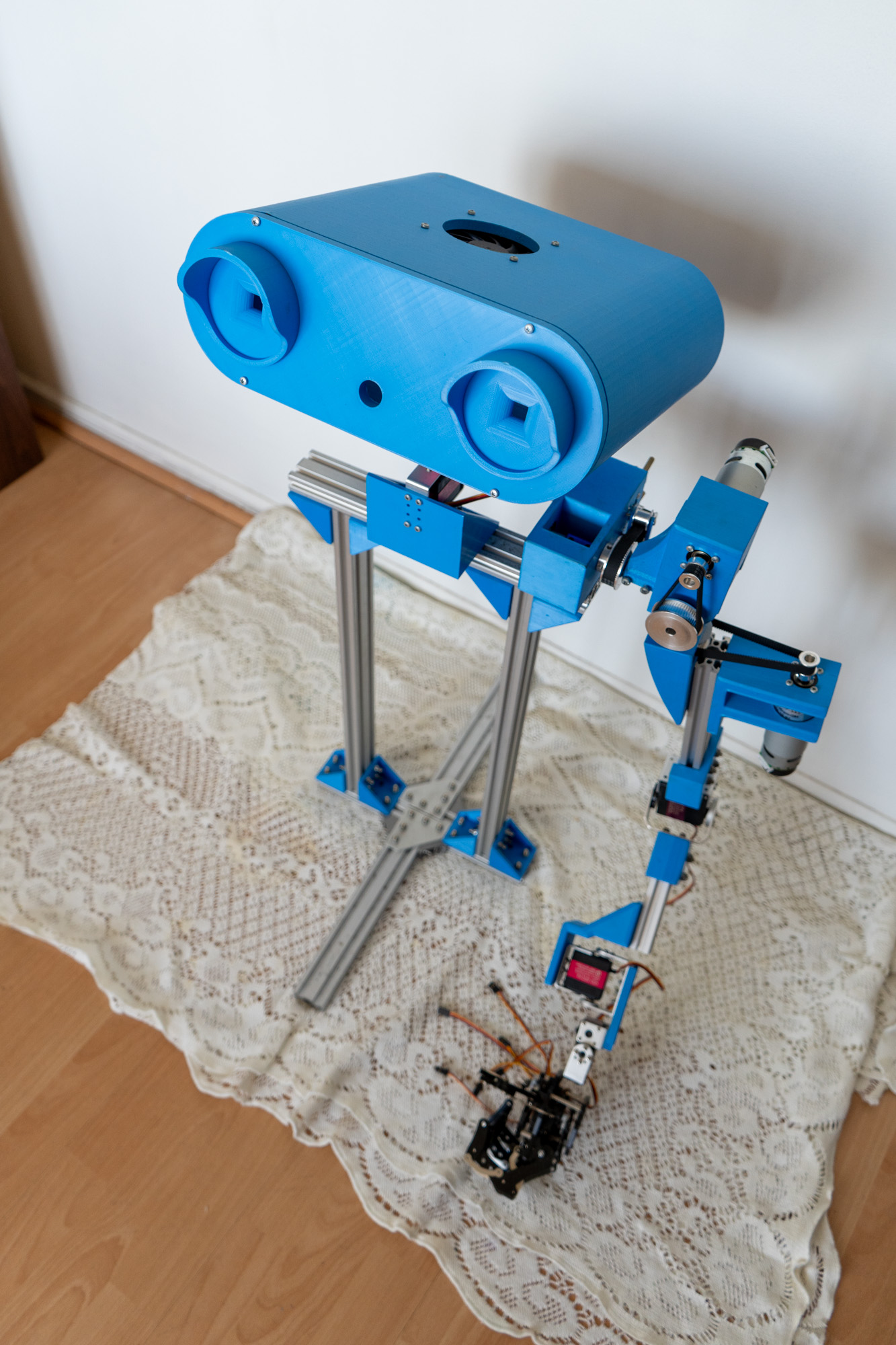

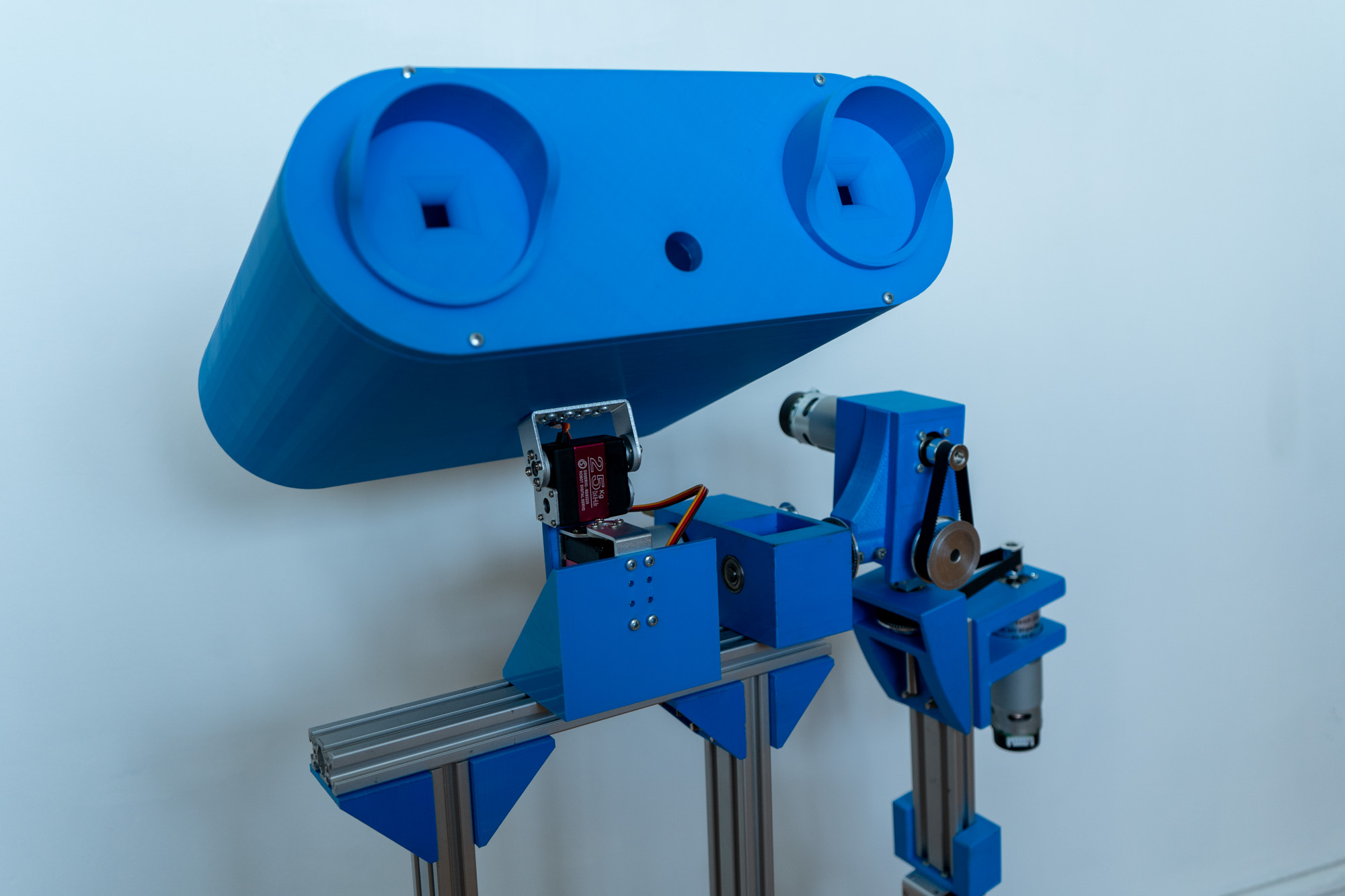

Cada subsistema es reemplazable de forma independiente. Brazos, manos, sensores — intercambiables.

Del micrófono al motor, todo corre en hardware local sin ninguna llamada externa.

Las mismas GPUs. El slot correcto. 35× más ancho de banda. Ese es el cambio.

| Característica | Raspberry Pi 5 (actual) | Xeon + P9X79 (nuevo) |

|---|---|---|

| CPU | ARM Cortex-A76 | Intel Xeon E5-2670 |

| Núcleos / Hilos | 4C / 4T | 8C / 16T |

| RAM | 8 GB LPDDR4X | 32 GB DDR3 Quad-Channel |

| Ancho de banda RAM | ~17 GB/s | ~50 GB/s |

| GPUs | 2× AMD RX 580 (8 GB c/u) | 2× AMD RX 580 (8 GB c/u) |

| PCIe por GPU | ~0.4 GB/s (x1 compartido) | ~14 GB/s (x16 real) |

| Carga modelo Whisper | ~3.5 s | ~0.03 s |

| Latencia total | ~6 s | ~1.7 s (estimado) |

| Consumo | ~60–80 W | ~200–300 W |

Lo que funciona, lo que está en desarrollo, y lo que viene.

Seis fases hacia un robot humanoide completamente autónomo.

Tres intentos fallidos antes de encontrar el equilibrio entre velocidad y precisión.

| Modelo | Tamaño | Tiempo | Precisión ES | Resultado | Estado |

|---|---|---|---|---|---|

ggml-base.bin |

147 MB | ~2.5 s | Mala | "[MÚSICA]" o "Thank you." con ruido | Descartado |

ggml-small.bin |

487 MB | ~5.0 s | Buena | 244M parámetros, español robusto | ACTIVO |

ggml-medium-q5_0 |

515 MB | ~30 s | Muy buena | Sin FP16 nativo en GCN 4 → FP32 emulado | Descartado |

whisper-server (small) |

487 MB | ~29 s | Buena | Bug Vulkan en GCN 4 — recrea shaders SPIR-V por llamada | Bug activo |

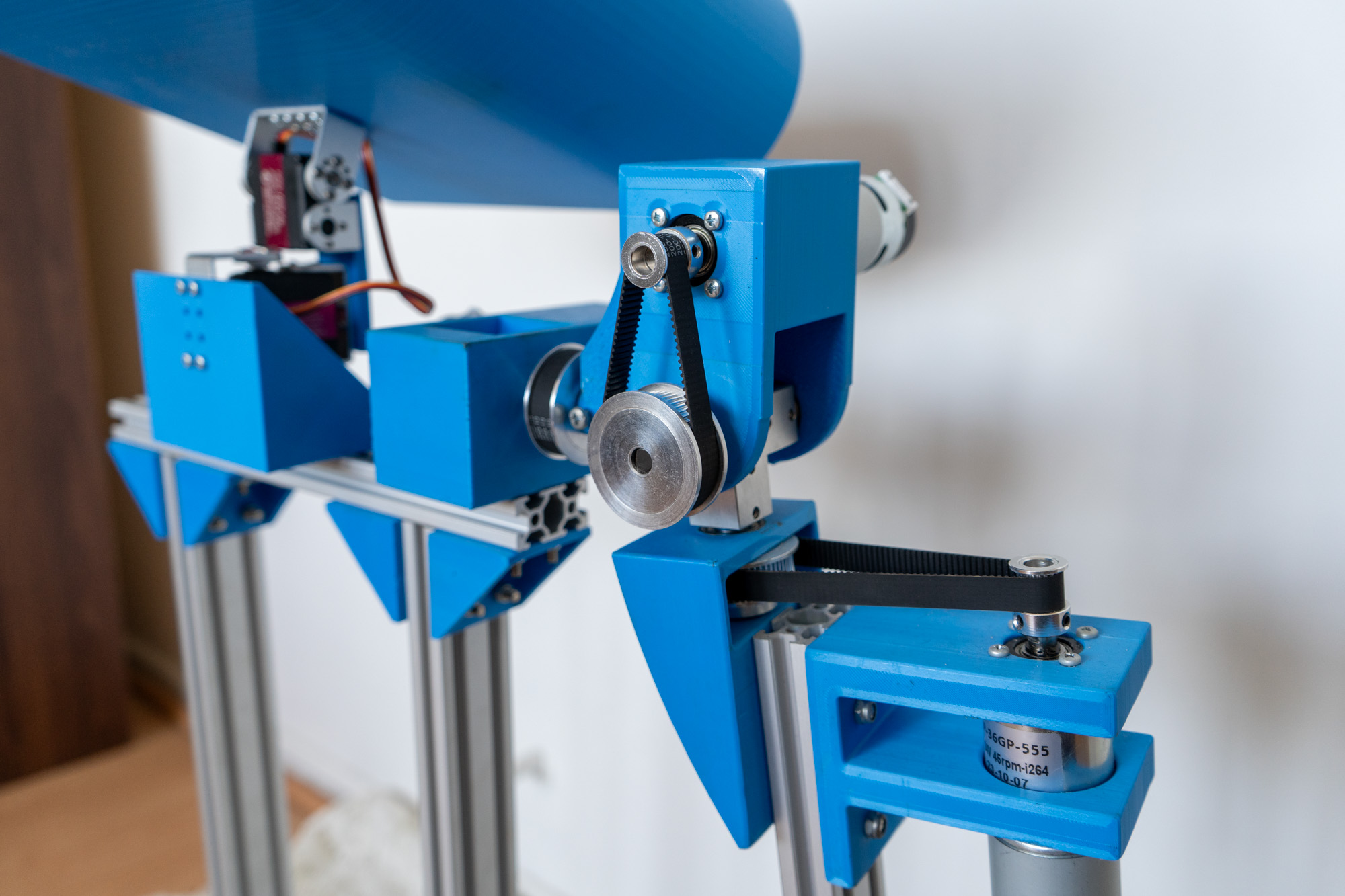

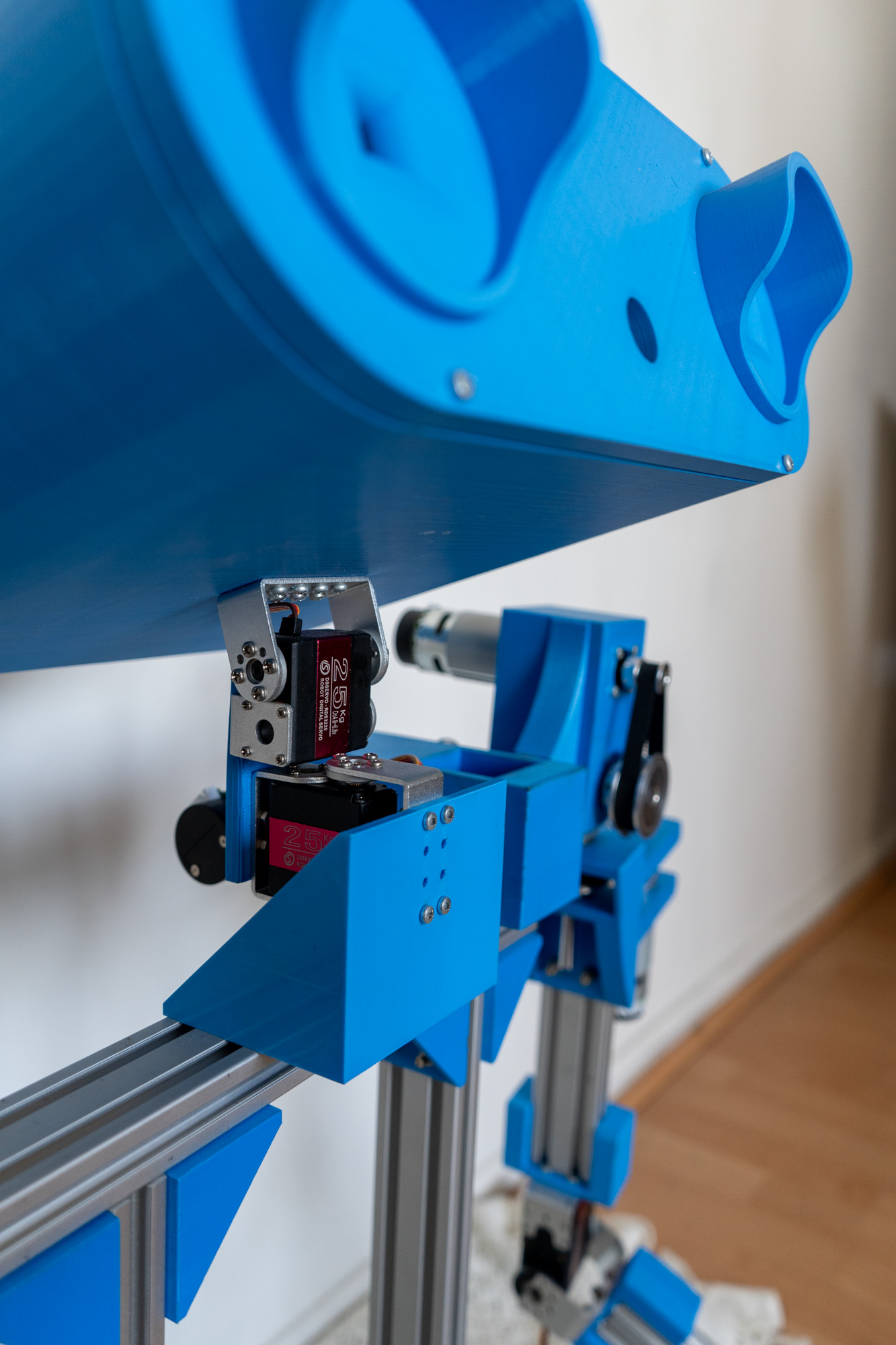

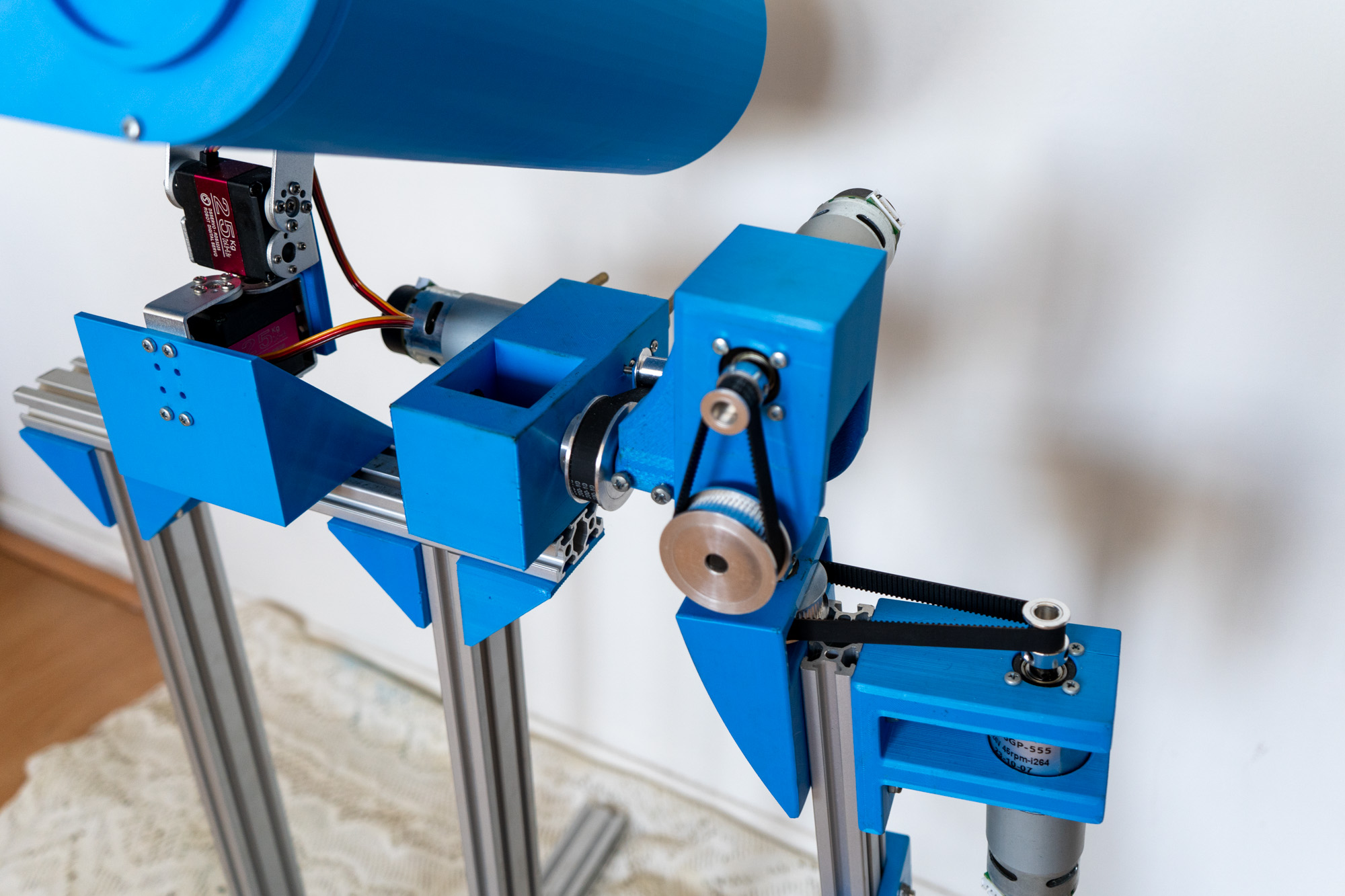

Construido con hardware de segunda mano y componentes de bajo costo. Sin financiamiento institucional.

De los sensores a los actuadores — todo el flujo de datos de CORAMO.

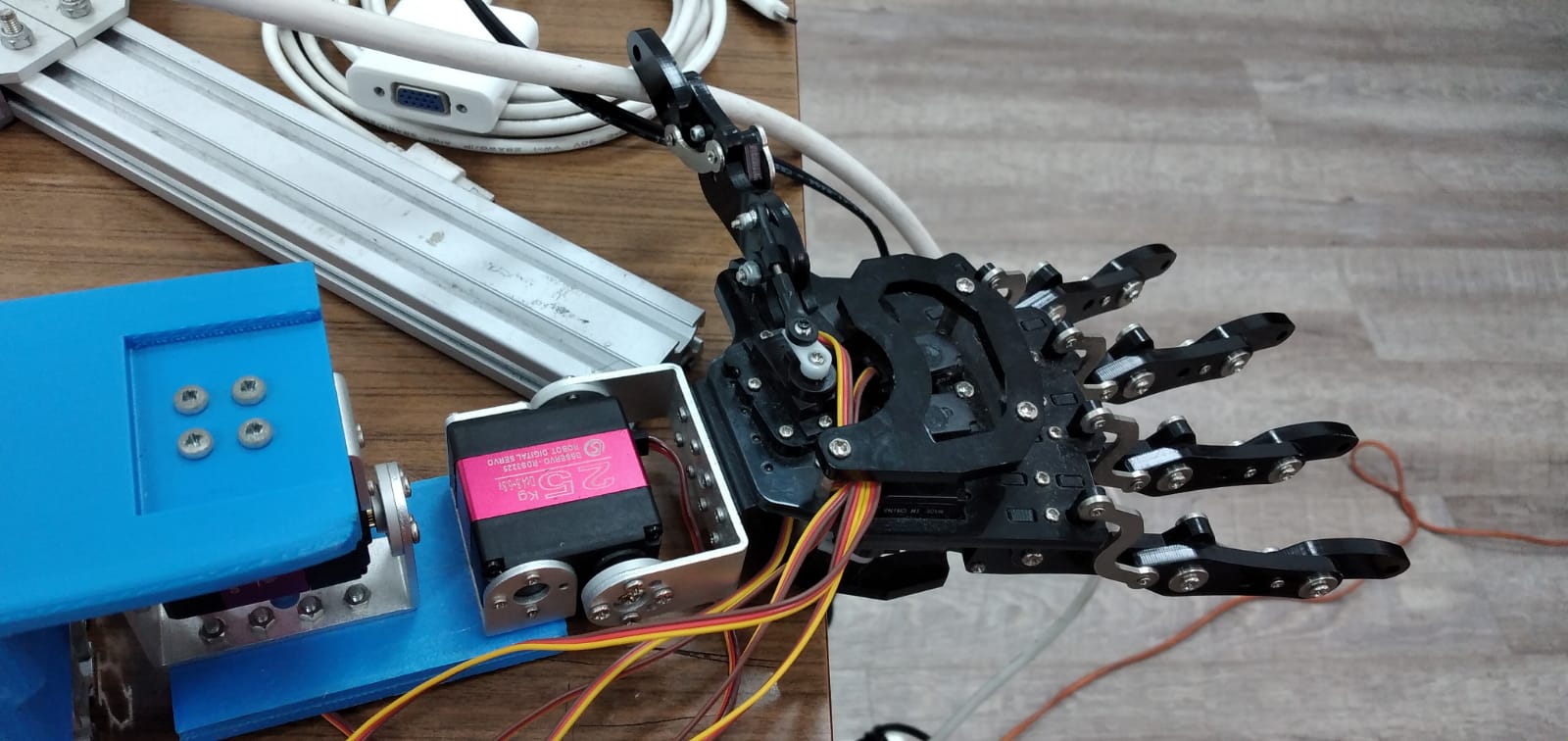

CORAMO moviéndose — control real de la mano robótica.

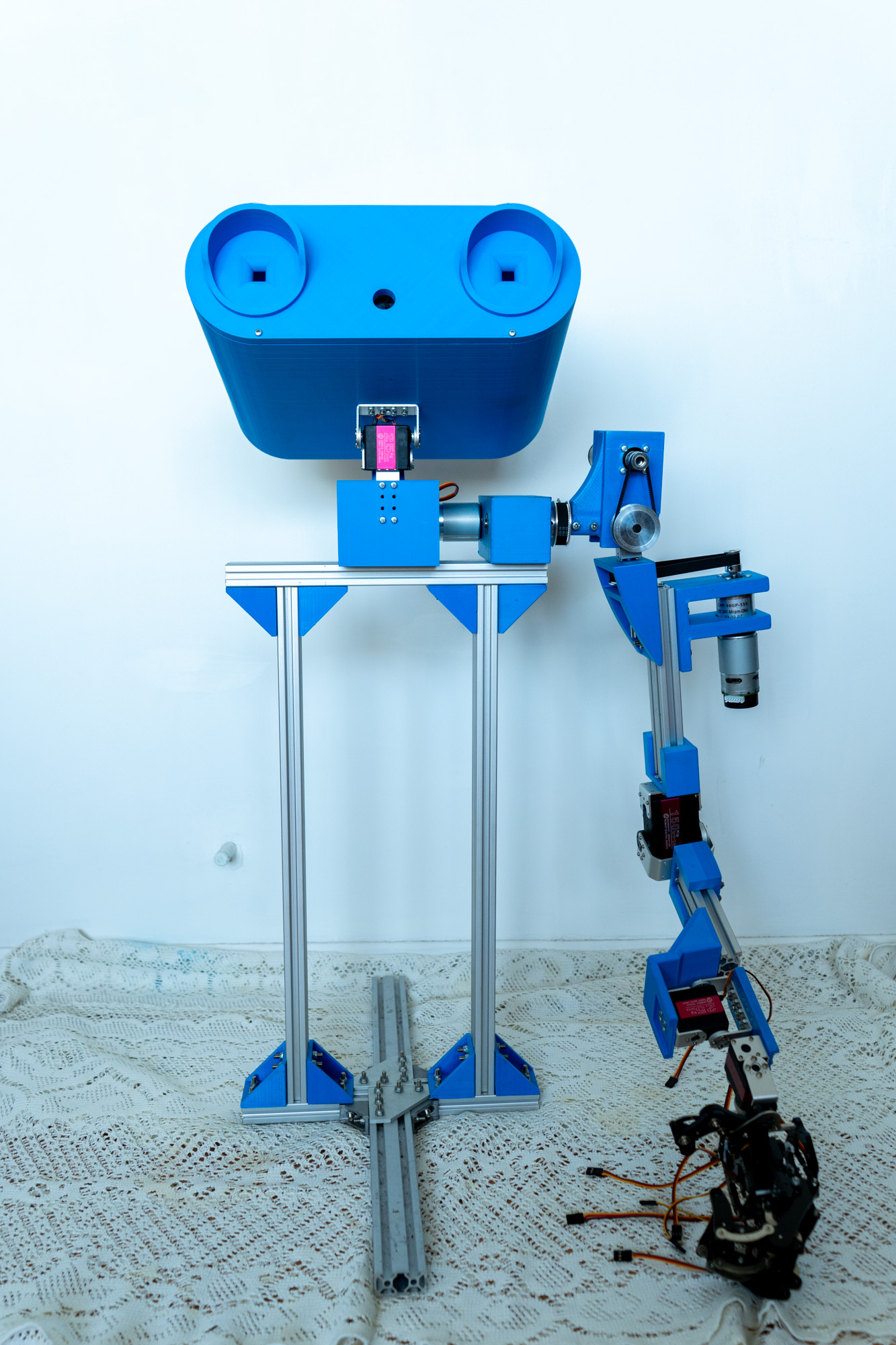

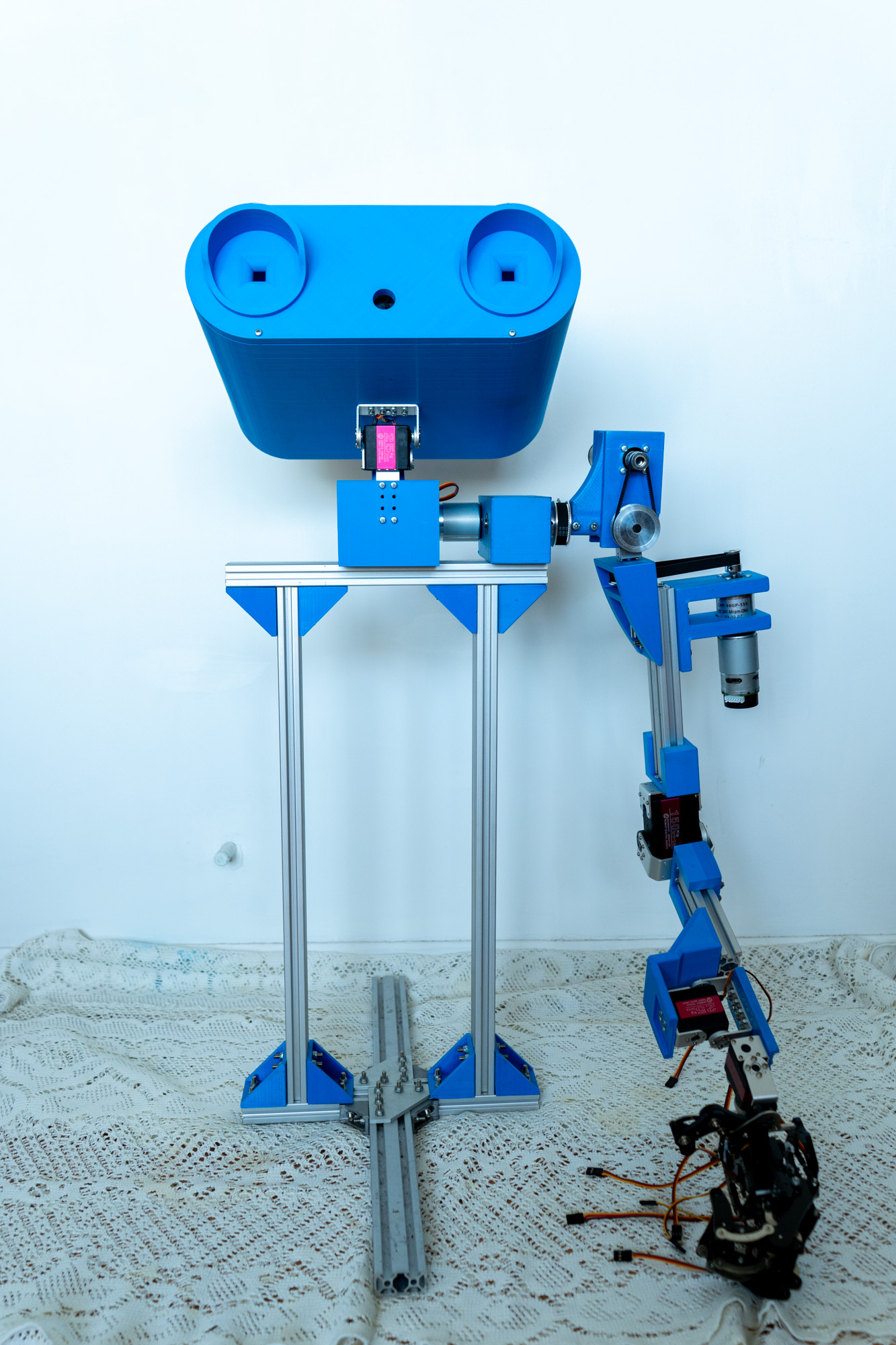

CORAMO construido desde cero con piezas impresas en 3D y perfiles de aluminio.

Documentando el proceso real, incluyendo los fallos.

Todo el código del proyecto es público y documentado.

Si el proyecto te parece interesante, ayuda compartiéndolo. Cada persona que lo conoce puede aportar ideas, colaboración o simplemente apoyo.

¿Tienes preguntas sobre el proyecto, quieres colaborar, o simplemente te interesa CORAMO?